一、爬虫技术的由来

爬虫技术的起源可以追溯到互联网的早期阶段。20世纪90年代初,随着万维网(World Wide Web)的诞生,互联网上的信息量急剧增长,用户手动浏览和检索数据变得效率低下。为了解决这一问题,研究人员开始开发自动化工具来抓取和索引网页内容。

1993年,麻省理工学院的马修·格雷(Matthew Gray)创建了第一个网络爬虫程序“万维网漫游者”(World Wide Web Wanderer),最初用于统计互联网上的服务器数量。随后,1994年,华盛顿大学的布莱恩·平克顿(Brian Pinkerton)开发了“WebCrawler”,这是第一个能够索引整个网页内容的爬虫程序,并成为早期搜索引擎的核心技术。随着搜索引擎巨头如Google(1998年)和百度(2000年)的兴起,爬虫技术得到了快速发展,成为互联网数据收集的关键工具。如今,爬虫技术已广泛应用于搜索引擎、数据分析、价格比较和学术研究等领域。

二、爬虫的工作原理

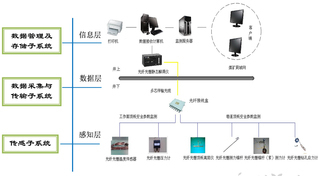

爬虫(又称网络蜘蛛或机器人)是一种自动化程序,其工作原理模拟人类浏览网页的过程,但速度和规模远超人工。其工作流程通常包括以下步骤:

- 种子URL队列:爬虫从一个或多个初始URL(称为种子)开始,这些URL由用户或系统预先设定。

- 网页抓取:爬虫通过HTTP或HTTPS协议向目标服务器发送请求,获取网页的HTML、CSS、JavaScript等内容。

- 数据解析:抓取到的网页内容被解析,提取有用信息(如文本、链接、图片等)。常用解析工具包括正则表达式、XPath或BeautifulSoup等库。

- 链接提取:从解析后的内容中提取出新的URL链接,并将其添加到待抓取队列中,以便进一步爬取。这确保了爬虫可以遍历整个网站或互联网。

- 数据存储:提取的数据被存储到数据库或文件中,供后续分析使用,例如搜索引擎索引或商业智能应用。

- 去重与调度:为避免重复抓取,爬虫使用哈希表或布隆过滤器等技术对URL进行去重。同时,调度器管理抓取优先级,确保高效利用网络资源。

整个过程通常需要遵守网站的robots.txt协议,以避免对服务器造成过大负担或侵犯隐私。

三、爬虫技术的推广与应用

爬虫技术不仅在搜索引擎领域占据核心地位,还在多个行业中得到广泛推广,成为现代数据驱动决策的重要工具。以下是其主要应用领域:

- 搜索引擎:如Google、百度等使用爬虫索引全球网页,为用户提供快速检索服务。

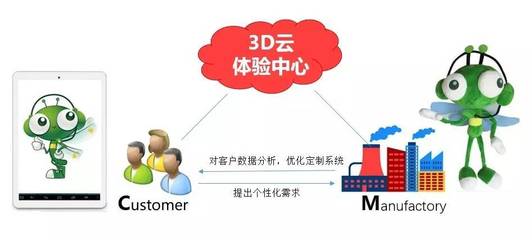

- 电子商务:企业利用爬虫监控竞争对手的价格、库存和产品信息,以优化定价策略。

- 金融与投资:爬虫抓取新闻、社交媒体和财报数据,用于市场分析和风险评估。

- 学术研究:研究人员使用爬虫收集公开数据,支持社会科学、数据挖掘等领域的实证研究。

- 社交媒体分析:爬虫帮助分析用户行为、趋势话题和情感倾向,用于营销和舆情监控。

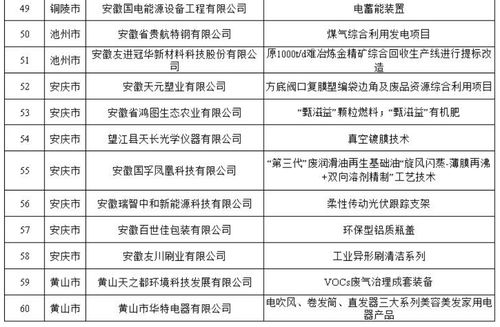

- 政府与公共服务:爬虫用于抓取公开数据,如天气信息、交通状况或政策文件,提升公共服务效率。

在推广过程中,爬虫技术也面临挑战,如反爬虫机制、法律合规性和道德问题。因此,开发者和企业需遵循相关法规(如GDPR),并采用伦理爬取策略,如限制请求频率和使用API接口。

爬虫技术作为互联网数据获取的基石,其发展推动了信息时代的进步。未来,随着人工智能和物联网的融合,爬虫技术将更加智能化和自动化,继续赋能各行各业。